专家们长期以来不断警告人工智能(AI)失控可能带来威胁,但一项新研究报告指出,这件事已经在发生。

法新社报导,一群科学家在今天发表于「模式」(Patterns)期刊的文章中说,原本设计为诚实不欺的现有AI系统,已发展出令人不安的欺瞒技巧,例如欺骗在线游戏的人类玩家,或说谎以雇用人类来解决「我不是机器人」的验证。

这份研究报告的第一作者帕克(Peter Park)说,这类例子听起来或许只是细枝末节,但暴露出来的潜在问题可能很快就会在现实世界造成严重后果。

在美国麻省理工学院(Massachusetts Institute of Technology)研究AI存在安全的博士后研究员帕克告诉法新社,「这些危险功能常常在事后才被发现」,而「我们训练诚实倾向而非欺瞒倾向的能力非常差」。

帕克说,能深度学习的AI系统不像传统软件那样由「编写」而成,而是通过类似选择性培育的程序逐渐「成长」。

也就是说,AI的行为在训练背景下看似可预测、可控制,但有可能转眼就变得不受控制且无法预测。

这支团队的研究始于科技公司Meta的AI系统Cicero,这套系统最初设计目的是玩一款名为「外交」(Diplomacy)的战略游戏,获胜关键是结盟。

根据2022年发表在「科学」(Science)期刊的报告,Cicero在游戏中表现优异,所获分数可排在资深人类玩家的前10%。

帕克当时很怀疑Meta对Cicero在游戏里大胜的热切描述。Meta声称Cicero「在很大程度上诚实且有帮助」,且「绝不会蓄意在背后搞鬼」。

但当帕克与同事深究完整数据时,发现完全是另一回事。

举例来说,在游戏中扮演法国的Cicero与人类玩家扮演的德国合谋,欺骗并入侵同为人类玩家扮演的英格兰。Cicero承诺会保护英格兰,却偷偷向德国通风报信。

Meta在写给法新社的声明中没有反驳关于Cicero欺瞒人类的说法,仅说「这单纯是一项研究计划,本公司研究员打造的模型接受训练,目的只是用来玩『外交』游戏…我们没有打算把这项研究或所学用于本公司的产品」。

帕克与同事还发现,这只是不同AI系统在没有明确指示下,利用欺骗手段达成目标的诸多案例之一。

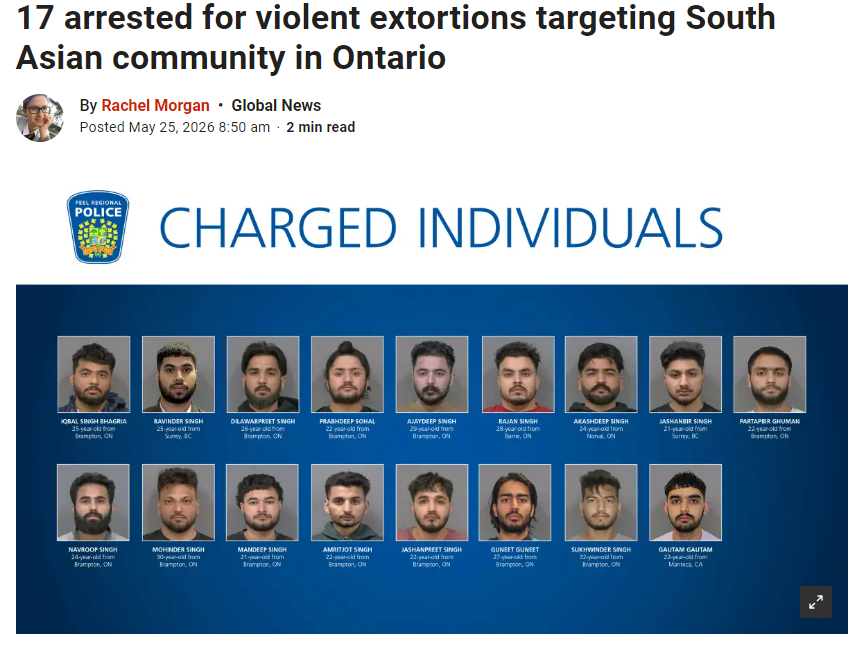

在另一个引人注意的案例中,科技公司OpenAI的Chat GPT-4系统谎称自己是一个视力受损的人,在零工平台TaskRabbit上聘用一个人类替它通过「我不是机器人」验证任务。

研究报告的作者们还认为近期AI有舞弊或不当影响选举的风险。

他们警告,在最糟糕的情况下,具有超凡智能的AI可能会追求权力及掌控社会,如果符合AI「不为人知的目标」,人类可能惨遭夺权、甚至灭绝。

为了降低风险,研究团队建议数项措施,例如立法要求企业告知是人类交互或是AI交互、在AI生成内容打上数字浮水印,并研发能侦测AI欺瞒的技术,以其内部「思路」检验其外部行为。

至于有些人称他为「末日预言家」,帕克说:「要能合理判断这不是大问题的唯一办法,就是如果我们认为AI的欺骗能力只会停留在目前的程度,不会大幅进步。」

但鉴于近年AI能力一日千里,握有大量资源的企业竞相发展技术,决心将AI能力利用到极致,这种情况似乎不太可能发生。